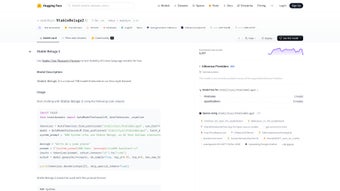

Stabil Beluga 2: En kraftfull AI-språkmodell

StableBeluga2 är en auto-regressiv språkmodell som är finjusterad på Llama2 70B-datasetet. Den är utformad för att generera text baserat på användarpromptar och kan användas för olika uppgifter inom naturlig språkbehandling, inklusive textgenerering och konversations-AI. Användare kan enkelt importera nödvändiga moduler från Transformers-biblioteket för att implementera modellen. Den accepterar en systemprompt, användarprompt och genererar ett svar från assistenten, vilket gör den flexibel och anpassningsbar.

Modellen möjliggör anpassning genom parametrar som top-p och top-k, vilket ger användarna kontroll över utdata. StableBeluga2 är tränad med en intern Orca-stil dataset och optimerad med AdamW. Trots sina styrkor är det viktigt att notera att modellen kan ge felaktiga eller partiska svar, vilket innebär att säkerhetstestning och justeringar är avgörande innan den används i produktionsmiljöer.